Эволюция СХД

Как менялись технологии хранения данных

Возможно, самая увлекательная часть компьютерной истории – это хроника систем хранения данных...

До появления компьютеров на протяжении столетий в простейших устройствах с программным управлением...

Казалось бы, перфоленты – более практичные носители, но в бизнесе они практически не использовались, хотя...

Способ записи звука на катушечный магнитный носитель, сначала на проволоку, позже на ленту, был ...

Временным способом для разрешения противоречий между технологией последовательной записи на ленту и ...

Активная жизнь гибких (floppy) дисков растянулась на 30 лет с конца семидесятых до конца девяностых Они оказались...

Александр Белл предпринял попытку записать звук на диск, покрытый воском, сфокусированным лучом света примерно...

Для словосочетания типа Hard Disk Drive (HDD) лингвисты используют название-ретроним – термин, придуманный...

Диски эволюционировали по нескольким магистральным направлениям:повышение скорости и емкости дисков...

Первые диски, в таком конструктиве, который стал прототипом для современных накопителей, создала шотландская...

Исторически первой составляющей операционных систем, поддерживающей работу с дисками, стали файловые...

Хотя диски HDD называют устройствами с прямым доступом, это утверждение условно.По сути они очень похожи на...

Во времена мэйнфреймов и мини-ЭВМ данные хранили на больших, логически не связанных между собой, чаще всего...

В конце 90-х удачно сошлись две новации - научная база RAID и выпускаемые массовым тиражом винчестеры. Если ...

Развитие сетевых технологий привело к появлению двух сетевых решений для СХД е-сетей хранения Storage Area ...

Многоуровневое хранение данных (Data multy tiering) можно рассматривать как один из компонентов более широкого ...

Возможно, самая увлекательная часть компьютерной истории – это хроника систем хранения данных (CXД), потому что в этой области было большое разнообразие и в физике, и в системной организации, к тому же много лет здесь все было очень наглядно. Компьютеры довольно скоро лишились зрительной привлекательности, на смену красивым и разнообразным вакуумным лампам и отдельным полупроводниковым компонентам (триодам и диодам) пришли одноликие интегральные схемы и микропроцессоры. Теперь мы можем различать по надписям что-то, заключенное в корпуса разных размеров, различающихся количеством контактов. Физика полупроводниковых новаций в конечном итоге сводится к поиску научных и технологических решений, обеспечивающих увеличение плотности транзисторов на подложке. Эти важнейшие достижения не имеют внешнего вида и для потребителя сводятся к цифрам 0.18, 0.13, 0.11… Впрочем, сегодня то же самое можно сказать и о дисках – внешне это коробки нескольких типоразмеров, различающиеся содержимым.

За 60–70 лет СХД эволюционировали от простейших карт и лент с дырочками, использовавшихся для хранения программ и данных, до накопителей на твердом теле. На этом пути было создано множество непохожих друг на друг устройств – это и магнитные ленты, и барабаны, и диски, и оптические диски. Часть из них осталась в прошлом: это перфорированные носители, магнитные барабаны, гибкие (флоппи) диски и оптические диски, а другие живут и будут жить долго. То, что сегодня ушло, можно посмотреть и поностальгировать в музее устаревших медийных технологий Museum Of Obsolete Media (http://www.obsoletemedia.org/). И в то же время, казалось бы обреченное, остается. В свое время предсказывали конец магнитным лентам, однако сегодня их существованию ничто не мешает, точно то же самое относится и к жестким вращающимся дискам (HDD), пророчества об их конце лишены какого-либо основания, они достигли такого уровня совершенства, что за ними сохранится их собственная ниша, невзирая ни на какие новации.

На нынешнем многоуровневом пейзаже СХД присутствуют ленточные библиотеки для резервного копирования и архивации, быстрые и медленные диски HDD, твердотельные диски SSD на флэш-памяти, мимикрирующие (интерфейсы, форм-фактор) под HDD прежде всего для согласования с существующим программным обеспечением и конструктивами, а также новейшие флэш-накопители в формате карт, подключаемых по интерфейсу NVMe. Эта картина сложилась под влиянием нескольких факторов, среди которых схема Джона фон Неймана, которая делит память на оперативную, непосредственно доступную процессору, и вторичную, предназначенную для хранения данных. Это деление укрепилось после того, как на смену сохраняющей свое текущее состояние ферритовой памяти пришла полупроводниковая, требующая загрузки программ для начала работы. И конечно же влияет удельная стоимость хранения, чем быстрее устройство, тем эта стоимость выше, поэтому в обозримом будущем останется место и для лент, и для дисков.

До появления компьютеров на протяжении столетий в простейших устройствах с программным управлением (ткацкие станки, шарманки, часы-карильоны) использовали перфорированные носители самых разных форматов и размеров и барабаны со штифтами. Сохраняя этот принцип записи, Герман Холлерит, основатель компании TMC, позже вошедшей в IBM, сделал открытие. Именно, в 1890 году он осознал, как можно использовать перфокарты для записи и обработки данных. Он реализовал эту идею при обработке статистических данных, полученных в ходе переписи населения, а позже перенес ее и в другие приложения, чем обеспечил благополучие IBM на десятилетия вперед.

Почему именно карты? Их можно сортировать и к ним может быть обеспечен, условно говоря, «прямой доступ» с тем, чтобы на специальном устройстве-табуляторе, следуя несложной программе, частично автоматизировать обработку данных.

Формат карт менялся, и с 20-х годов международным стандартом стали 80-колонные карты. Монополия на них до начала 60-х принадлежала IBM.

Эти простые картонки с прямоугольными отверстиями оставались доминирующим носителем данных на протяжении нескольких десятилетий, они производились миллиардами. Об объемах потребления карт можно судить хотя бы по одному примеру Центра расшифровки немецких радиограмм в Блечли Парке: неделя работы – 2 миллиона карт, это среднего размера грузовик! Послевоенный бизнес тоже строился на хранении данных на картах. Говоря о перфокартах, следует помнить, что они использовались в Германии для сбора данных о людях, подлежащих уничтожению.

Казалось бы, перфоленты – более практичные носители, но в бизнесе они практически не использовались, хотя устройства для ввода и вывода были существенно проще и легче. Их распространению мешал последовательный доступ, меньшая емкость и низкие скорости ввода и вывода, сложность архивации. Узкие 5-колонные перфоленты с 1857 года использовали для подготовки и последующей передачи данных по телеграфу, с тем чтобы не ограничить скорость ввода физическими возможностями оператора и тем самым лучше использовать пропускную способность канала. Широкие 24-колонные перфоленты были созданы для записи программ в электромеханическом калькуляторе Harvard Mark I в 1937 году. Как носитель, не подверженный воздействию разного электромагнитного и гамма-изучения, перфоленты широко использовались в качестве бортовых устройств, они до сих пор используются в некоторых оборонных системах.

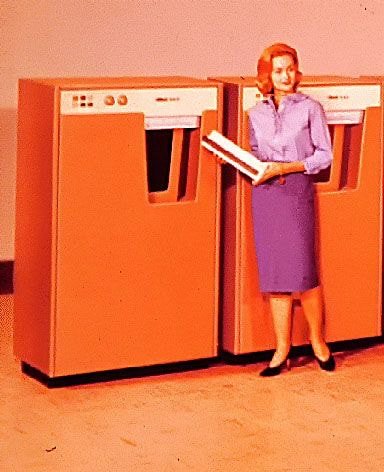

Способ записи звука на катушечный магнитный носитель, сначала на проволоку был предложен в 1928 году. Магнитофон такого типа использовался в UNIVAC-1. Началом истории компьютерных магнитных лент считается IBM Model 726, входившая в состав компьютера IBM Model 701. Ширина ленты для IBM Model 726 и других устройств того времени была равна одному дюйму, но такие ленты оказались неудобны в эксплуатации. Из-за их большой массы требовались мощные приводы, поэтому вскоре им на смену пришли полудюймовые «открытые ленты» (open reel), в которых перемотка осуществлялась с одной бобины на другую (reel-to-reel). Они имели три плотности записи 800, 1600 и 6250. Такие ленты со съемными кольцами для защиты от записи стали стандартом для архивирования данных до конца 80-х годов.

В Model 726 использовали катушки от кинопленки, соответственно ширина ленты оказалось равной одному дюйму, а диаметр бобины – 12 дюймам. Model 726 была способна сохранять 1,4 Мбайт данных, плотность 9-дорожечной записи составляла 800 бит на дюйм; при движении ленты со скоростью 75 дюймов в секунду в компьютер передавалось 7500 байт в секунду. Сама магнитная лента для Model 726 была разработана компанией 3M (теперь Imation).

Довольно скоро от дюймовых лент отказались, из-за их веса при работе в старт-стопном режиме требовались слишком мощные приводы и вакуумные карманы, и на длительный период установилось почти монопольное господство полудюймовых «открытых лент» (open reel), в которых перемотка осуществлялась с одной бобины на другую (reel-to-reel). Плотность записи повысилась с 800 до 1600 и даже 6250 бит на дюйм. Эти ленты со съемными кольцами для защиты от записи были популярны на компьютерах типа ЕС и СМ ЭВМ. полудюймовых «открытых лент» (open reel), в которых перемотка осуществлялась с одной бобины на другую (reel-to-reel). Плотность записи повысилась с 800 до 1600 и даже 6250 бит на дюйм. Эти ленты со съемными кольцами для защиты от записи были популярны на компьютерах типа ЕС и СМ ЭВМ.

Стимулом к дальнейшему развитию стало то, что в середине 80-х емкости жестких дисков стали измеряться сотнями мегабайт или даже гигабайтами поэтому для них понадобились накопители резервирования, соответствующей емкости. Неудобства открытых лент были понятны, даже в быту кассетные магнитофоны быстро вытеснили катушечные. Естественный переход к картриджам происходил двумя путями: один – создавать специализированные устройства, ориентированные на компьютеры (по линейной технологии): второй – обратиться к технологиям, изобретенным для видеозаписи и аудиозаписи с вращающимися головками (по винтовой технологии). С тех пор сложилось разделение на два лагеря, которое придает рынку накопителей неповторимую специфику.

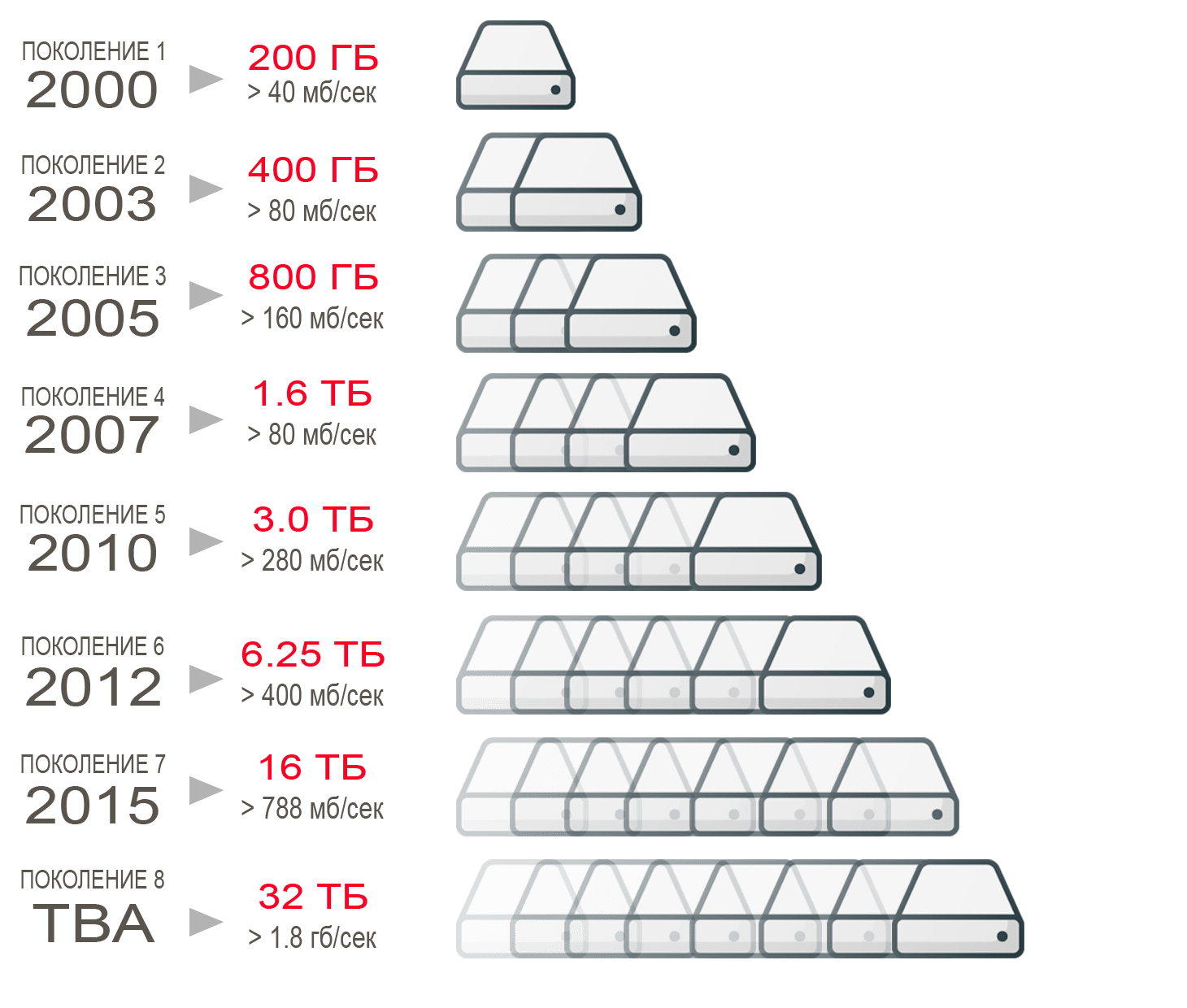

За тридцать лет было разработано несколько десятков стандартов картриджей, наиболее распространенный сегодня стандарт LTO (Linear Tape-Open), в процессе которых картриджи совершенствовались, повышалась их надежность, емкость, скорость передачи и другие эксплуатационные характеристики. Современный картридж – это сложное устройство, снабженное процессором и флэш-памятью.

Переходу на картриджи способствовало то, что сейчас ленты работают исключительно в потоковом режиме. Картриджи используются либо в автономных устройствах, либо в составе ленточных библиотек. Первой роботизированную библиотеку на 6 тыс. картриджей выпустила компания StorageTek в 1987 году.

Аналитики и производители дисков не раз предрекали лентам кончину. Известен лозунг «Tapes must die», но они живы и будут жить долго, потому что рассчитаны на многолетнее хранение больших архивов. Размер бизнеса, связанного с производством лентопротяжек, лент и ленточных библиотек в 2017 году оценивался примерно в $5 млрд. И чем больше становятся объемы информации, которые можно сохранить на жестких дисках, тем больше потребность в архивировании и создании резервных копий. На чем? Разумеется, на лентах: экономически оправданной по стоимости хранения альтернативы магнитным лентам пока не найдено. Нынешнее 8-е поколение стандарта LTO позволяет штатно сохранить до 12 Тб, а в компрессированном режиме 30 Тб, перспективе эти цифры возрастут на порядок и более, при смене поколений повышаются не только количественные показатели, но и другие эксплуатационные характеристики.

Временным способом для разрешения противоречий между технологией последовательной записи на ленту и необходимостью прямого доступа к данным на внешнем устройстве стал магнитный барабан, точнее цилиндр с неподвижными головками. Его изобрел австриец Густав Тучек в 1932 году

Магнитным является не барабан, у которого, как известно, рабочей поверхностью служит днище, а цилиндр с нанесенным на его боковую поверхность ферримагнитным покрытием, разделенным на дорожки, а они, в свою очередь, делятся на секторы. Над каждой из дорожек размещена собственная головка чтения/записи, причем все головки могут работать одновременно, то есть операции чтения/записи осуществляются в параллельном режиме.

Барабаны использовались не только в качестве периферийного устройства. До перехода на ферритовые сердечники оперативная память была чрезвычайно дорогой и ненадежной, поэтому в ряде случаев барабаны играли роль оперативной памяти, были даже компьютеры, называвшиеся барабанными. Обычно магнитные барабаны использовались для оперативной (часто изменяемой) или важной информации, к которой был нужен быстрый доступ. В условиях ограничений на размер оперативной памяти из-за ее дороговизны на них хранилась копия операционной системы, записывались промежуточные результаты выполнения программ. На барабанах впервые была реализована процедура свопинга, представляющая виртуализацию памяти за счет пространства на барабане, а позже и на диске.

Накопители на магнитных барабанах имели емкость меньше, чем диски, но работали быстрее, потому что в отличие от дисков в них головки неподвижны, что исключает время, требуемое для подвода к нужной дорожке.

Барабаны активно использовались вплоть до начала 80-х годов, некоторое время они жили параллельно с дисками. Барабанами комплектовалась ЭВМ БЭСМ 6 и ее современники. Из открытых источников известно, что последние барабаны простояли в системах управления ракетами Минитмэн до середины 90-х годов.

Активная жизнь гибких (floppy) дисков растянулась на 30 лет с конца семидесятых до конца девяностых. Они оказались чрезвычайно востребованными в связи тем, что ПК появились раньше, чем у пользователей появилась возможность передачи данных по сети. В этих условия флоппики служили не только по прямому назначению для хранения резервных копий, но, пожалуй, в большей степени для обмена данными между пользователями, вот почему их еще называют sneaker, как кроссовки, типичную обувь программистов. Обмениваясь флоппиками, они создавали своего рода сеть – sneakernet.

Существовало 3 основных типа дисков и множество различных модификаций. Флопии-диски диаметром 8 дюймов были созданы в 1967 году в IBM, они задумывались как устройство первоначальной загрузки (bootstrap) для мэйнфреймов IBM/370 на замену более дорогой постоянной памяти (non-volatile read-only memory), ею комплектовалось предшествующее поколение IBM/360. Однако, осознав коммерческую ценность новинки, в 1971 IBM превратила флоппи в самостоятельный продукт, а в 1973 году руководитель разработки Алан Шугарт создал компанию Shugart Associates, ставшую ведущим производителей 8-ми дюймовых дисков с максимальной емкостью 1,2 Мбайта. Эти большие диски использовали на ПК, выпускавшихся до появления IBM XT. Особую популярность этот тип дискет получил благодаря операционной системе CP/M Гарри Килдала.

Что же касается дискет с диаметром 5,25 дюйма, то их появление напоминает анекдот о Николае II, который дольно своеобразно объясняет увеличенную ширину российской железнодорожной колеи по сравнению с европейской. В нашем случае Эн Ванг, хозяин компании Wang Laboratories, встретился в баре с выходцами из Shugart Associates, которые предложили сделать для его компьютеров более дешевый дисковод, но они не могли решиться на конкретный диаметр. Тогда Ванг взял коктейльную салфетку и сказал, что ему кажется, что размер должен быть таким. Пятидюймовые диски емкостью 360 и 720 Кб выпускали до конца девяностых годов, они были современниками компьютеров IBM XT и IBM AT, операционных систем MS-DOS и DR-DOS, верно служа становлению новой отрасли.

Предложенный в 1983 году Sony альтернативный картридж имел размер 90,0 мм × 94,0 мм, но его по традиции стали называть 3,5 дюймовым. В американской профессиональной среде он зовется стиффи (stiffy disk, перевод стоит посмотреть в словаре). После ряда усовершенствований в 1987 году был принят отраслевой стандарт 3,5-inch HD (High Density) с емкостью 1,44 Мб. Поначалу такими дисками комплектовали IBM PS/2 и Macintosh IIx, а позже он стал универсальным стандартом для PC и Macintosh. Попытки сделать во второй половине девяностых диски большей емкости Extended Density (ED) 2,88 Мб, а также казавшиеся перспективными магнитооптические Floptical disk 25 Мб, SuperDisk 120-240 Мб и HiFD 150-240 Мб рыночного успеха не имели.

Александр Белл предпринял попытку записать звук на диск, покрытый воском, сфокусированным лучом света примерно 130 лет назад, почти одновременно с изобретением граммофона Томасом Эдисоном. Его метод вырезания звуковой дорожки оказался практичнее. Это изобретение оказалось забыто, но комплект записанных им восковых дисков сохранился в Смитсониевском музее (Вашингтон), в 2013 году эти диски удалось прочесть и прослушать голоса более чем вековой давности.

Эксперименты в этом направлении не выходили из стен лабораторий вплоть до 1984 года, когда компании Sony и Denon разработали стандарт на диски CD, позже появилась возможность не только читать, но и записывать данные на диск при помощи устройства, ставшего в последствии стандартом для ПК. С этого момента CD стали устройством для СХД, их емкость составила примерно 700 Гб. Вторым поколением в 2000 году стали оптические диски DVD с емкостью 4,7 Гб, и третьим – диски Blu-ray, способные хранить 25 Гб. Все три могли быть использованы в качестве периферийных устройств. Сейчас ведутся работы над четвертым поколением, но комплектация ими СХД не предполагается.

Есть несколько причин отказа от оптических дисков:

Для словосочетания типа Hard Disk Drive (HDD) лингвисты используют название-ретроним – термин, придуманный лингвистами для уже нового названия существующего явления, чтобы отличать его от чего-то более нового, в данном случае от гибких дисков. И вот странная ситуация: гибких дисков нет, потребности различать гибкие диски от жестких нет, а ретроним остался, но теперь он служит для отличия HDD от твердотельных накопителей Solid State Drive/Disk (SSD), которые в общем и дисками то не являются.

Нынешняя волна публичного интереса к SSD не должна вводить в сомнение относительного будущего HDD, эти диски жили и будут жить, постоянно развиваясь и совершенствуясь. В ближайшее время появится диск емкостью 20 Тб, а общий выпуск растет постоянно на 1–3% в год.

Успех дисков выглядит как некоторый казус. В механическом устройстве, ставшем неотъемлемой частью электронных систем, время перемещения головок измеряется совсем иными величинами, нежели скорость электронных процессов. На отсутствие гармонии в союзе между электроникой и механикой обратили внимание давно, еще в пятидесятые годы, когда создавались первые диски. Но тогда механике не было альтернативы, поскольку полупроводниковые технологии делали только первые шаги, пришлось сознательно пойти на неравный брак ради достижения цели, однако он оказался более чем успешным. Целью же был прямой доступ к большим (по тем меркам) объемам данным, который оставался невозможен до тех пор, пока данные считывались в потоке либо с ленты, либо с перфокарт. Считанные с носителя данные можно было разместить либо в крошечной оперативной памяти, либо делать своппинг и подкачивать данные с барабана. В некоторых операционных системах были утилиты для чтения файлов с лент, но это был ужасно медленный процесс.

Идея диска как устройства с перемещающимся по пространству головками лежала на поверхности и попытки ее реализовать предпринимались многими компаниями. В Компьютерном музее в Маунтин Вью хранится несколько вариантов дисков. Коммерческий успех раньше других пришел к IBM, способной потратить на разработку больше остальных, поэтому во всех хрониках эволюции дисков в качестве начальной точки указывается дата 1956 год и накопитель на дисках, входивший в состав компьютера IBM 305 RAMAC (Random Access Method of Accounting and Control), в названии которого прямо указано на его уникальную по тому времени возможность произвольного доступа – Random Access Method.

Но IBM не была первой. Раньше всех работающий накопитель сделал самородок-изобретатель Яков Рабинов (1910-1999) в 1951 году, отдавший всю жизнь работе в Национальном бюро стандартов. Он родился в Харькове, в оригинале его фамилия была Рабинович, после революции в 1921 году он с родителями через Китай перебрался в США, а потом почти 70 лет проработал в исследовательском подразделении Национального бюро стандартов. Рабинов не стал ученым, но он был гением практических изобретений, среди них, например, усовершенствованная технология чеканки, продлевающая срок жизни монет, изобретение принесло Государственному казначейству много миллиардов экономии на выпуске металлической мелочи. Однако, лишь одно из его изобретений – устройство, которое называлось Notched-Disk Magnetic Memory Device – не принесло ему ни денег, ни прижизненного признания. Оно состояло из десяти 18-ти дюймовых «блинов», так в последующем стали называть собственно диски, с вырезанным сегментом, чтобы их можно было менять на оси.

Эксперты из IBM изучали изобретение Рабинова и не скрывали приоритет. Проанализировав диск Рабинова, в 1953 году они выпустили отчет «Предложения по произвольному доступу к файлам данных» (A Proposal for Rapid Random Access File), который стал основой проекта RAMAC.

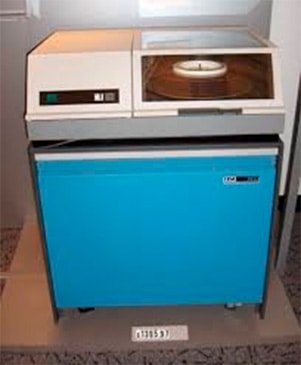

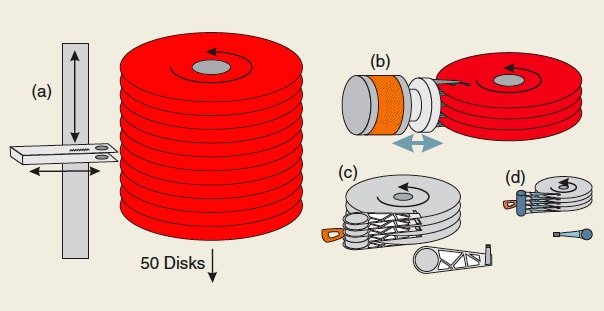

Первый накопитель IBM на дисках не существовал как отдельно взятый продукт, он был частью компьютера IBM 305 RAMAC и состоял из пятидесяти 24-ти дюймовых блинов, вращавшихся со скоростью 2000 об/мин, общая емкость составляла 3,75 Мб, что эквивалентно 64 000 перфокартам. По двум вертикальным штангам перемещались вверх и вниз коромысла с головками, переход от одного блина к другому занимал 1 секунду. Устройство весом около тонны не продавалось, его можно было только взять в лизинг. В последующем та же стратегия сохранялась при выпуске моделей 650, 1401, 1410 и 7070 и только в 1962 году появился накопитель Model 1301, который поставлялся отдельно от компьютера. В нем впервые появились плавающие головки, они были расположены на гребенке по одной головке на каждый блин. Емкость Model 1301 составляла 28 Мбайт.

Изобретение Рабинова не было защищено патентным правом внутри США, поэтому в дисковый бизнес мгновенно ринулось множество компаний, на пике их общее число достигло 138, но по мере усложнения технологий производства большая часть из них ушла с рынка, и к 2015 году остались Seagate, Toshiba и Western Digital, каждой из трех принадлежит примерно треть рынка.

На первых порах одной из наиболее успешных стала компания Bryant Computer Products, которая раньше других применила плавающие головки и зонирование (запись данных пропорционально длине дорожки, изменяющейся по диаметру). Bryant выпустила накопитель с самыми большими блинами диаметром 39 дюймов, их было 26, и суммарная емкость тоже была рекордной – 205 Мб.

Очередной шаг в развитии дисковых накопителей был сделан IBM в 1962 году с выпуском накопителя Model 1311,он отличался от предшественников появлением съемного носителя, в котором уменьшенные до 14 дюймов блины, сбирались на шпиндель внутри пакета. Этот шаг был революционным: во-первых, ценовой компромисс – на один дорогой привод стало возможным ставить в неограниченном количестве дешевые пакеты, во-вторых, снималось ограничение на объем хранимых данных и, в третьих, безопасность – пакеты можно был содержать вне компьютерного зала. Устройства этого типа стали стандартом де-факто не только для мэйфреймов, но и для более многочисленных миникомпьютеров. В производство пакетов емкостью 100 или 200 Мб по стандарту IBM включилось большое число компаний, сложился определенный стандарт де-факто, в итоге 14-ти дюймовые диски продержались на рынке более 20 лет вплоть до массового распространения дисков-винчестеров.

В семидесятые годы сосуществовали два направления в развитии дисков. Одно наследовало идеи, сохранившиеся со времени IBM Model 1301, оно предполагало строить большие, быстрые, но очень дорогие накопители наподобие IBM 3380 Direct Access Storage Device, который первым преодолел гигабайтный рубеж. Потребителями таких штучных устройств могли быть только государственные организации или крупнейшие корпорации.

Второй путь – развитие идеи съемных пакетов, отличающихся от 14-ти дюймовых тем, что в пакете помимо собственно дисков размещаются и коромысла с приводами.

Примером этого направления стал накопитель IBM 3340 Direct Access Storage Facility, его кодовое имя на момент проектирования было Winchester, он впервые появился в 1973 году. Это прозвище сохранилось за IBM 3340 по той причине, что в него устанавливались два пакета по 30 Мб, 30-30, как в известном ружье. Любопытно, что слова винчестер, а также ксерокс, в качестве нарицательных называний, как в русском, в английском не используются.

Переход к винчестерам стал возможен за счет предварительной разметки дисков, на поверхность которых наносятся управляющие серводорожки. На рисунке (а) показана схема работы диска RAMAC, на (b) – 14-дюймового диска, в них устанавливаются дорогие прецизионные приводы. А на винчестерах (c) и (d) привод существенно проще, здесь требуется только лишь подвести коромысло к нужной дорожке, головка «вцепляется в нее, между серводорожкой и головкой устанавливается обратная связь, и она сохранятся до следующего перемещения коромысла.

На этом предыстория дисков заканчивается и начинается совсем другая новейшая история, она менее наглядна, но чрезвычайно интересна с инженерной точки зрения.

Времена уникальных дисковых устройств остались в прошлом, прежде всего под влиянием массового производства ПК, для которых потребовались дешевые, небольшие по размеру, но большие по емкости накопители. Эту потребность можно было удовлетворить, наладив массовое производство дисков с диаметром 5, 3,5 и 2,5 дюймов и приняв стандарты интерфейсов SCSI и ATA. Из этих дисков оказалось возможным собирать по технологии RAID надежные и высокопроизводительные массивы. Отдельного и более детального рассмотрения заслуживают файловые системы, технологии виртуализации и распределенные системы хранения и, конечно же твердотельные накопители, современные интерфейсы и сетевые технологии, применяемые с СХД

Диски эволюционировали по нескольким магистральным направлениям:

Нынешняя волна публичного интереса к SSD не должна вводить в сомнение относительного будущего HDD, эти диски жили и будут жить, постоянно развиваясь и совершенствуясь. В ближайшее время появится диск емкостью 20 Тб, а общий выпуск растет постоянно на 1–3% в год.

Развитие по первому направлению привело к появлению таких HDD, которые способны хранить терабайтные объемы и поддерживать высокие скорости обмена.

По второму – к созданию поддерживающих работу дисков аппаратных и программных средств: файловых систем, способных поддерживать терабайтные диски и абстрагирования от физики хранения, в т.ч. скоростных интерфейсов, RAID-массивов, обеспечивающих высокую надежность хранения, сетей хранения SAN и сетевых накопителей NAS.

По третьему – к появлению совсем недавно созданных твердотельных устройств корпоративного уровня (Solid State Device, SSD) в сочетании с ориентированным на эти устройства интерфейсом NVMe. Теперь открылась возможность «умного хранения», то есть автоматического оптимального по затратам перераспределения хранения данных между SSD, HDD и лентами в зависимости от востребованности данных.

Первые диски, в таком конструктиве, который стал прототипом для современных накопителей, создала шотландская компания Rodime, она выбрала в качестве образца формат популярных тогда 3,5 флоппи-дисков. Выпущенные ею в 1983 году модели RO351 и RO352 имели емкость 6,38 и 12,75 Мб соответственно. По тем временам этот не так мало, оригинальные PC XT комплектовались 5-дюймовыми дисками 5–10 Мб, заметно большими по размеру. В дальнейшем прогресс в области ферримагнитных материалов, способов записи и приводов позволили за 25 лет увеличить емкость дисков в миллион раз. Эволюция механики дисков, материалов и способов записи заслуживает специального рассмотрения.

Однако, как бы ни были высоки показатели емкости и соотношения емкость/цена у самых совершенных HDD, при них остаются их врожденные недостатки – большая задержка как неизбежное следствие механики и последовательные операции чтения и записи, неизбежные при перемещении головки над дорожкой.

Против ожиданий процесс создания быстродействующей электронной твердотельной постоянной памяти (Solid State Device, SSD) проходил медленно: потребовалось более четверти века экспериментов, чтобы лишь в конце 1990-х на рынке появились первые накопители NVM (Non-Volatile Memory). Успешнее других оказались эксперименты с технологией NAND, которую стали называть «флэш». С начала 2000-х она прочно вошла на рынок гаджетов, но только в 2013 году проникла и в корпоративные системы.

Длительность процедуры внедрения NVM обусловлена не столько техническими проблемами, сколько тем обстоятельством, что изначально все современные корпоративные информационные системы создавались именно в расчете на HDD, поэтому сдерживающим фактором стала инерционная масса существующей инсталляционной базы.

Флэш-память является частью более широкой совокупности возможных решений для создания NVM, или «памяти класса хранилища» (Storage-Class Memory, SCM). Помимо флэш-памяти, в эту категорию технологий попадают еще более десятка альтернативных физических методов, среди которых преимущество пока имеют следующие пять: мемристоры (Resistive Random Access Memory, ReRAM); магниторезистивная память с произвольным доступом (Magneto-resistive Random-Access Memory, MRAM); память с изменением фазового состояния (Phase-change memory, PCM); память на доменной стене (Domain-Wall Memory, DWM) и атомная память (Atomic memory). Кроме них, известны еще энергонезависимая статическая память с произвольным доступом (nvSRAM); сегнетоэлектрическая оперативная память (Ferroelectric RAM, FeRAM или FRAM); память на основе механического позиционирования углеродных нанотрубок (Nano-RAM). Из всего этого множества наиболее близки к практическому внедрению ReRAM и PCM.

Область внедрения SCM лежит между памятью и дисками, а поскольку производительность и стоимость технологий, потенциально пригодных для создания SCM, варьируются, то среди решений могут быть более быстрые, близкие по производительности к памяти, и более медленные, сравнимые по производительности с дисками. Сопоставимая по скорости с DRAM память на мемристорах или PCM позволит напрямую подключить к процессору большой объем памяти.

Из нескольких путей самый радикальный и логически простой предполагает подключение карт Solid State Card (SSC) в форм-факторе PCIe по интерфейсу NVMe непосредственно к серверам, хотя это самый логичный и высокоскоростной способ, но он пока применим для ограниченного числа новых приложений. Поэтому широкое распространение получают твердотельные накопители Solid State Drive с той же аббревиатурой SSD, выпускаемые в тех же форм-факторах, что и HDD — 5,25, 3,5, 2,5 и 1,8 дюйма, эмулирующие HDD.

Прямая замена HDD на SSD в существующих СХД вполне допустима, однако она не позволяет в полной мере реализовать потенциал флэш, поэтому остается несколько вариантов создания новых СХД. На данный же момент по экономическим соображениям в количественном отношении будут преобладать гибридные СХД, сочетающие в себе лучшие качества обоих видов накопителей: и HDD, и SSD – их производство растет со скоростью 8–10% в год.

Параллельно, по мере снижения цены флэш-памяти, все большую массовость приобретают массивы All-Flash Arrays (AFA), построенные исключительно на SSD. Этот сегмент рынка пока меньше гибридного, но растет в несколько раз быстрее. И здесь тоже есть свои варианты. Ряд компаний, главным образом стартапы, создают принципиально новые решения класса AFA с нуля (built from the ground up). Те же крупные вендоры, чьи проверенные временем массивы сохраняют потенциал для модернизации, доводят свои существующие продукты путем модернизации ПО и железа до уровня AFA. Они создают системы, которые называют оптимизированными под SSD (flash optimizing storage systems). Можно привести в качестве примера HP с 3PAR StoreServ.

Преимущество массивов AFA, относящихся к категории built from the ground up, по сравнению с optimizing storage systems состоит в том, что их заново написанные операционные системы лучше используют физические возможности флэш, это очевидно и не вызывает возражений. Но не менее очевидно и другое обстоятельство: из-за короткого периода существования built from the ground up им не хватает возможностей тех системных средств для управления данными корпоративного уровня (advanced data management features), которые были разработаны за десятилетия для HDD. Вот почему серьезные унаследованные приложения используют эти наработки, без них преимущества в скорости SSD сводится к нулю. Из сказанного следует, что нельзя в лоб сравнивать описанные выше два типа систем, на данный момент у каждого из них есть свои преимущества и перед пользователем стоит проблема выбора той СХД, которая точнее соответствует его требованиям. Для тех, кому важна в чистом виде скорость работы, больше подходят built from the ground up, если же критичны еще и требования корпоративного уровня, то предпочтительнее optimizing storage systems, сочетающие зрелые программные платформы с высокой надежностью и стабильностью, с более высокой, свойственной AFA скоростью работы.

HDD своих позиций не уступают, в прошлом году компания Western Digital представила HDD объемом 14 Тб по технологии черепичной магнитной записи и гермозоны с гелием, а на подходе технология микроволновой магнитной записи (MAMR), в 2022 году та же WD планирует выпустит диск емкостью 40 Тб, у которого удельная стоимость хранения будет на порядок ниже, чем у SSD.

Исторически первой составляющей операционных систем, поддерживающей работу с дисками, стали файловые системы, поначалу их функционал был ограничен распределением дискового пространства и сохранением имен файлов, присвоенных пользователями.

Компьютерный файл – это самый нижний уровень абстрагирования данных от физического хранения, существующих в виде байтов на носителе. Сегодня, говоря о файлах, чаще всего подразумевают файлы на дисках, к тому же данные в форме файлов хранятся и на флэшках, CD, DVD и на лентах резервного копирования. На компьютерах понятие «файлы» использовали с сороковых годов, так называли колоду перфокарт.

На чем бы ни хранился файл, он состоит из массива данных и фолдера – контейнера, содержащего данные, с уникальным идентификатором. В приложении к компьютерным данным фолдер называют метаданными, то есть данными о данных. Термин «дисковый файл» (disk file) впервые был употреблен в документации к диску IBM 350 (1956), а «файловая система» (file system) в одной из первых операционных с разделением времени Compatible Time-Sharing System (CTSS), разработанной в Массачусетском технологическом институте в 1961 году. На ее основе была создана OC Multics, которая в свою очередь вдохновила создателей Unix.

В 1973 году Гарри Килдал разработал файловую систему в составе своей ОС CP/M для 8-разрядного ПК, ее он затем переделал в DR-DOS 16- разрядного ПК, после чего в результате несложной комбинации против воли автора эта файловая система обрела новое воплощение в виде File Allocation Table (FAT) компании Micrоsoft.

По мере увеличения размеров дисков возникали новые файловые системы, одним из важнейших шагов стала Unix File System (UFS), она дала толчок к развитию целой плеяды файловых систем. Вершиной стала 128-битовая файловая систем Zettabyte File System (ZFS), разработанная в Sun Micro Systems.

В последние годы под влиянием необходимости работать с большими данными развитие файловых систем ускорилось. Их можно разделить на две категории: распределенные, обычно устанавливаемые на кластеры, и традиционные, но рассчитанные на работу с большим объемами данных. Из первых наибольшую известность получили Lustre, GPFS и две системы, созданные «по мотивам»

Lustre, — GlusterFS и Ceph. Система GPFS является коммерческой, остальные доступны в открытых кодах. Менее популярны системы XtreemFS, MogileFS, pNFS, ParaScale, CAStor и Tahoe-LAFS. Во второй категории безусловный лидер – ZFS и близкая ей LZJB, дополненная алгоритмом сжатия данных без потерь. Кроме этого имеются еще NILFS, разработанная в Nippon Telephone and Telegraph CyberSpace Laboratories, и Veritas File System, разработанная компанией Veritas Software. Не исключено и паллиативное решение, где совмещаются файловые системы из обеих групп.

Возможно, самая увлекательная часть компьютерной истории – это хроника систем хранения данных (CXД), потому что в этой области было большое разнообразие и в физике, и в системной организации, к тому же много лет здесь все было очень наглядно. Компьютеры довольно скоро лишились зрительной привлекательности, на смену красивым и разнообразным вакуумным лампам и отдельным полупроводниковым компонентам (триодам и диодам) пришли одноликие интегральные схемы и микропроцессоры. Теперь мы можем различать по надписям что-то, заключенное в корпуса разных размеров, различающихся количеством контактов. Физика полупроводниковых новаций в конечном итоге сводится к поиску научных и технологических решений, обеспечивающих увеличение плотности транзисторов на подложке. Эти важнейшие достижения не имеют внешнего вида и для потребителя сводятся к цифрам 0.18, 0.13, 0.11… Впрочем, сегодня то же самое можно сказать и о дисках – внешне это коробки нескольких типоразмеров, различающиеся содержимым.

На компенсацию этих генетических дефектов дисков нацелены нынешние последовательные дисковые интерфейсы SATA и SAS, технологии сборки дисков в кластеры, RAID-массивы и многие иные технические средства. Совместно они вполне успешно «примиряют» электронику с механикой и обеспечивают дискам безбедное существование на годы вперед.

До их появления доминировали параллельные интерфейсы. Чем же вызван возврат от параллельных интерфейсов к последовательным, ведь еще на памяти замена старых последовательных интерфейсов параллельными? Потребовались годы, чтобы осознать, что параллелизм оказался временным решением. Сначала казалось, что замена одного провода несколькими в соответствующее число раз увеличивает скорость. Появление плоских кабелей воспринималось как высокое техническое достижение. Однако у этой технологии есть серьезный органический дефект: она обостряет проблему синхронизации. Можно до определенного предела наращивать скорость передачи, повышая частоту шины, но за этим пределом издержки на синхронизацию превышают преимущества параллелизма. На самом деле параллельная шина работает только в те короткие моменты времени, когда поступают внешние синхроимпульсы, все остальное время она попросту простаивает. Последовательный канал по определению предполагает включение разделительных меток внутрь передаваемых данных, данные идут единым потоком, поэтому есть возможность для полного использования пропускной способности канала. Параллелизация коснулась обоих интерфейсов, и более дорого и быстрого, изначально рассчитанного на корпоративные накопители SCSI, и более дешевого, уходящего корнями в ПК ATA.

Последовательный интерфейс SAS (Serial Attached SCSI) разработан для замены и на основе параллельного интерфейса SCSI, в нем используется набор команд SCSI. Первая версия параллельного интерфейса SCSI была представлена компанией Shugart Associates в 1979 году под именем SASI (Shugart Associates System Interface), в 1986 году под именем SCSI он был принят в качестве стандарта ANSI.

К 2001 году, после двух десятилетий постоянного усовершенствования параллельного варианта SCSI, стало очевидно, что ресурсы этого интерфейса исчерпаны. Тогда, в осознании приближающего тупика, группа компаний-производителей жестких дисков организовала «мозговой штурм» с участием ведущих экспертов отрасли. Результатом этой акции стали предложения по созданию нового интерфейса — Serial Attached SCSI. В дальнейшем эти предложения были переданы в технический комитет ANSI INCITS T10, где к 2003 году они были доведены до стадии стандарта ANSI.

Прародителем SATA был ATA, это название восходит к 16-битовой ISA, появившейся IBM PC/AT (1992). AT в IBM PC/AT расшифровывается как Advanced Technology (продвинутая технология), то ATA соответственно Advanced Technology Attachment. Многие помнят ленточные кабели в корпусах ПК. Они ушли вместе с Serial ATA (SATA) в 2003 году, а для оригинального ATA был предложен ретроним Parallel ATA или PATA.

С появлением SSD возникла еще одна проблема – как их подключать? В современных условиях сохраняются два способа подключение флэш: через контроллер системы хранения по интерфейсам SATA и SAS или прямо через контроллер ввода-вывода, обычно по интерфейсу PCIе по NVMe. Те, что подключаются по SATA и SAS, стали называть дисками, хотя это название не проходит утиный тест (Если нечто выглядит как утка, плавает как утка и крякает как утка, то это, вероятно, утка и есть). SSD выглядит действительно как диск, у него тот же форм-фактор, он крякаяет как диск (те же интерфейсы), но SSD плавает, то есть хранит данные иначе.

Естественно, что пока наибольшее распространение получили «твердотельные диски» на базе флэш-памяти, эмулирующие HDD и подключаемые по SATA или SAS. Однако это решение столь же логичное, сколь и неэффективное — дисковые интерфейсы позволяют задействовать лишь малую часть потенциальной производительности флэш-памяти. Подключение флэш-памяти по SATA или SAS можно рассматривать как временную альтернативу. Тем не менее SSD удается использовать в высокопроизводительных гибридных и полностью твердотельных массивах (All Flash Array).

С гораздо большей эффективностью раскрытие потенциала флэш-памяти обеспечивает подключение по шине PCIе интерфейс NVMe (NVM Express), ему эксперты предрекают роль, по значимости равную SCSI. Прототип под именем NVMHCI (Non-Volatile Memory Host Controller Interface) был представлен в 2007 году. Первая версия спецификации NVMe была представлена 1 марта 2011 года, текущая редакция NVMe 1.3c – четвертая по счету, она вышла 24 мая 2018 года.

Протокол NVMe рассчитан не только на современную флэш-память, но и на будущие версии твердотельной энергонезависимой памяти. NVMe позволит выпускать накопители в форм-факторе 2,5 дюйма, реализующие в полной мере все скрытые возможности решений NVM. Для развития NVMe создана группа NVM Express Work Group, а индустрия получила возможность создания стандартизованных драйверов, способных реализовать весь потенциал электронной твердотельной постоянной памяти. Используя коммутаторы NVMe, из устройств типа SSD можно создавать неограниченные по размерам пространства хранения.

На мэйнфреймах и мини-ЭВМ использовали 14-дюймовые диски, а позже винчестеры. Трудно поверить, но такой диск емкостью 600 Мб весил несколько десятков килограммов. Позже в противовес RAID такие диски стали именовать «одиночными большими дорогими дисками» (Single Large Expensive Disk, SLED), вот вам еще один ретроним.

В 1987 профессора Дэвид Паттерсон и Рэнди Кац из Университета Беркли, предложили свежую идею: объединить в один массив диски от персональных компьютеров, назвав свое решение массивом недорогих дисков с резервированием (Redundant Array of Inexpensive Disk, RAID). Кластер из дисков был устроен таким образом, чтобы извне он рассматривался как один диск. Но дешевизна – не главное достоинство RAID, важнее то, что кластер из независимых дисков можно было объединять по различным схемам (по так называемым «уровням» RAID), обеспечивающим большую или меньшую степень сохранности данных за счет избыточности. Поэтому букву I в аббревиатуре стали расшифровывать и как Independent («независимый»). Конфигурации на дисках ATA еще можно считать недорогими, но чаще в корпоративных массивах стоят диски SCSI или Fibre Channel.

Еще одно замечательное качество RAID – многократно большая скорость обмена, она линейно зависит от числа шпинделей. Таким образом, распараллеливание решает проблему «бутылочного горла» на канале диск-компьютер. Но, если просто избыточно увеличивать число дисков, то надежность системы будет уменьшаться.

Данные по дискам распределяются по полосам размером от нескольких килобайтов до нескольких мегабайтов. Вторая процедура для повышения надежности – зеркалирование. Массивы RAID различаются по сочетанию этих процедур. Есть выбор между скоростью доступа и надежностью, возможны и «компромиссные» варианты.

Есть два подхода к реализации RAID: аппаратный и программный. Первый не отнимает ресурсы у процессора, он надежнее, но дороже. Второй тип RAID дешевле.

Следует различать функции AST с той ролью, которую играет кэш-память на флэш, подключаемая по NVMe. Принцип работы кэша проще, чем AST, любой кэш является инструментом, в него на время копируется фрагмент из более медленной памяти. Кэш – простой ускоритель, AST – оптимизирует использование ресурсов СХД.

В конце 90-х удачно сошлись две новации – научная база RAID и выпускаемые массовым тиражом винчестеры. Если собрать их вместе, оказалось возможным создать коммерческий накопитель кластерного типа, способный конкурировать с дисками IBM по техническим показателям при существенно меньшей цене.

Гигантизм дисков, выпускавшихся до появления винчестеров, находился в противоречии с незамысловатой логикой этих устройств. Их логика была примитивна, она почти полностью соответствовала физической инфраструктуре (сектора и дорожки). И, как малотиражные и специализированные изделия, они были дороги.

В 1988 году Майкл Рюттгерс, который в дальнейшем стал главным стратегом EMC, предложил разработать дисковую систему, состоящую из винчестеров, и поставлять их для мэйнфреймов, совместимых с IBM, и для AS/400. Другой, пожалуй, самый удачливый специалист по СХД Моше Янаи выдвинул идеологию кэш-памяти Integrated Cached Disk Array (ICDA), в результате родился прародитель дисковых кластеров EMC Symmetrix.

Осенью 1990 года, когда EMC представила Symmetrix, ставший легендой дисковых массивов, модель 4200 ICDA имела емкость 24 Гбайт, кэш-память 256 Мбайт и контроллер на базе 32-разрядного процессора. Symmetrix за несколько лет вывел компанию на позицию ведущего поставщика накопителей для мэйнфреймов. По данным IDC, ее доля на рынке накопителей для мэйнфреймов возросла с 1% (в 1990 г.) до 42,5% (в 1996 г.).

Symmetrix был дешев для мэйнфреймов, но слишком дорог для Unix-серверов и тем более для х86 серверов, поэтому немало компаний рвануло в открывшийся сегмент рынка, они предложили продукты, уступающие Symmetrix по качеству, но не столь дорогие. В последующем на рынке появилось множество моделей дисковых массивов самого разного назначения.

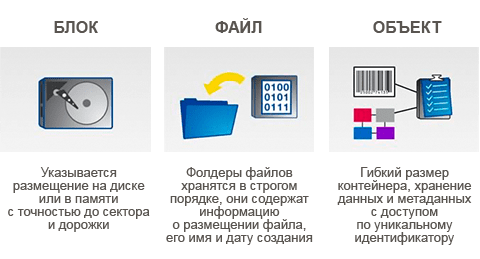

Развитие сетевых технологий привело к появлению двух сетевых решений для СХД – сетей хранения Storage Area Network (SAN) для обмена данными на уровне блоков, поддерживаемых клиентскими файловыми системами, и серверов для хранения данных на файловом уровне Network Attached Storage (NAS). Чтобы отличать традиционные СХД от сетевых был предложен еще один ретроним – Direct Attached Storage (DAS).

Появлявшиеся на рынке последовательно DAS, SAN и NAS отражают эволюционирующие цепочки связей между приложениями, использующими данные, и байтами на носителе, содержащим эти данные. Когда-то сами программы-приложения читали и писали блоки, затем появились драйверы как часть операционной системы. В современных DAS, SAN и NAS цепочка состоит из трех звеньев: первое звено – создание RAID-массивов, второе – обработка метаданных, позволяющих интерпретировать двоичные данные в виде файлов и записей, и третье – сервисы по предоставлению данных приложению. Они различаются по тому, где и как реализованы эти звенья. В случае с DAS СХД является «голой», она только лишь предоставляет возможность хранения и доступа к данным, а все остальное делается на стороне сервера, начиная с интерфейсов и драйвера. С появлением SAN обеспечение RAID переносится на сторону СХД, все остальное остается так же, как в случае с DAS. А NAS отличается тем, что в СХД переносятся к тому же и метаданные для обеспечения файлового доступа, здесь клиенту остается только лишь поддерживать сервисы данных.

Появление SAN стало возможным после того, как в 1988 году был разработан протокол Fibre Channel (FC) и в 1994 утвержден ANSI как стандарт. Термин Storage Area Network датируется 1999 годом. Со временем FC уступил место Ethernet, и получили распространение сети IP-SAN с подключением по iSCSI.

Идея сетевого сервера хранения NAS принадлежит Брайану Рэнделлу из Университета Ньюкэстла и реализована в машинах на UNIX-сервере в 1983 году. Эта идея оказалась настолько удачной, что была подхвачена множеством компаний, в том числе Novell, IBM, и Sun, но в конечном итоге сменили лидеров NetApp и EMC.

В 1995 Гарт Гибсон развил принципы NAS и создал объектные СХД (Object Storage, OBS). Он начал с того, что разделил все дисковые операции на две группы, в одну вошли выполняемые более часто, такие как чтение и запись, в другую более редкие, такие как операции с именами. Затем он предложил в дополнение к блокам и файлам еще один контейнер, он назвал его объектом.

OBS отличается новым типом интерфейса, его называют объектным. Клиентские сервисы данных взаимодействуют с метаданными по объектному API (Object API). В OBS хранятся не только данные, но еще и поддерживается RAID, хранятся метаданные, относящиеся к объектам и поддерживается объектный интерфейс. DAS, и SAN, и NAS, и OBS сосуществуют во времени, но каждый из типов доступа в большей мере соответствует определенному типу данных и приложений.

Многоуровневое хранение данных (Data multy tiering) можно рассматривать как один из компонентов более широкого давнего понятия виртуализации памяти.

Термин virtual по отношению к памяти и СХД возник в 1959 году для обозначения виртуальной по своей сути внешней памяти на дисках, используемой для расширения внутренней памяти, которую в ту пору собирали из магнитных сердечников. Она по определению была очень маленькой, но при этом чрезвычайно дорогой. Маленькую и дорогую память подменяли прозрачным для процессора способом более дешевой дисковой памятью несравненно большего размера. В современных системах хранения точнее вести речь об интеграции хранения, замене физических адресов и номеров устройств логическими адресами и логическими номерами устройств и о более эффективных методах управления.

Появление SSD дало новый импульс к продолжению работ по виртуализации, нынешний этап называют Automated Tiered Storage (AST), на нем автоматически выполняются процедуры DataTiering, то есть перемещения данных по уровням хранения.

Появление SSD дало новый импульс к продолжению работ по виртуализации, нынешний этап называют Automated Tiered Storage (AST), на нем автоматически выполняются процедуры DataTiering, то есть перемещения данных по уровням хранения.

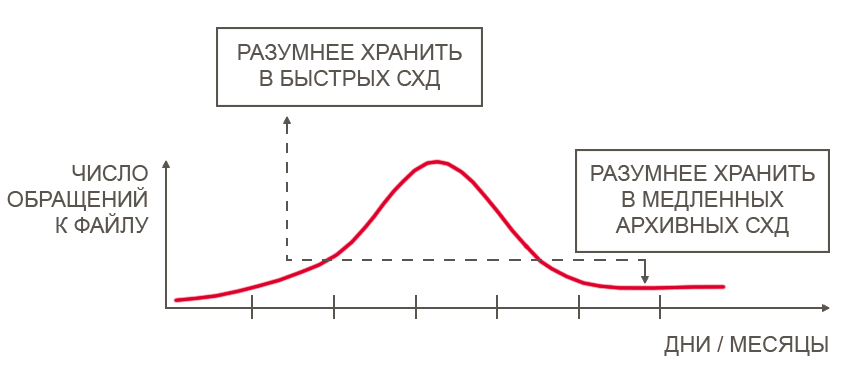

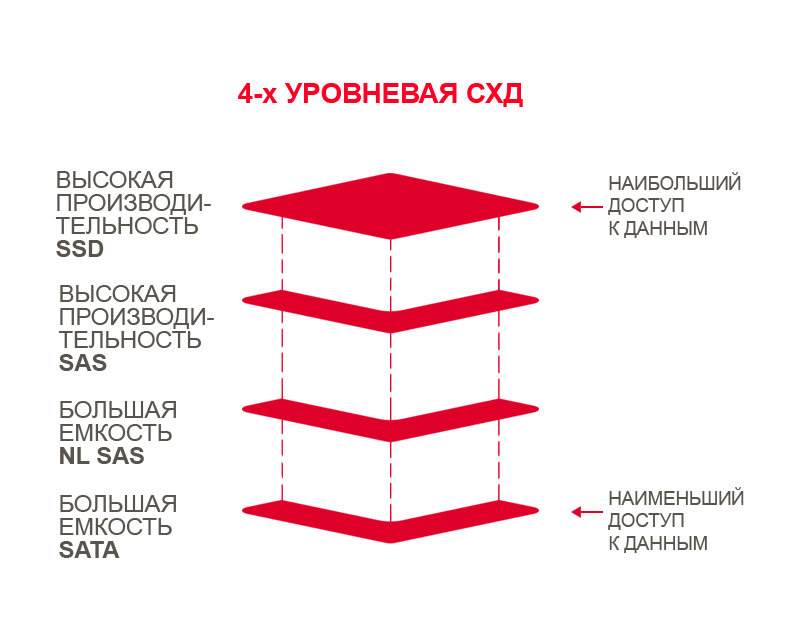

Необходимость в миграции данных связана с природой данных. Кривая распределения числа обращений к данным по времени напоминает гауссову кривую – количество обращений к свежим данным, требующим быстрого доступа, невелико, по мере старения данных оно возрастает, а далее падает и к архивированным данным на медленных устройствам количество обращений существенно меньше пикового. Это свойство данных побуждает к созданию многоуровневых СХД, на нынешнем уровне развития технологии можно реализовать 4-х уровневую модель: на 0 уровне – SSD, на них хранятся наиболее востребованные данные; на 1 уровне – быстрые диски SAS; на 2 уровне – медленные диски SAS или SANA, на 3 уровне – ленты. Принятая прежде трехуровневая схема из дисков SAS, SATA и лент устарела.

AST можно считать развитием ранее известного управления иерархическим хранением данных Hierarchical Storage Management (HSM), созданного в 1974 году для дисковой библиотеки IBM 3850, которая совместно с дисками впервые позволила образовать единое пространство данных. Возможно, использование нового названия отражает ускорение процессов миграции до уровня реального времени, что позволяет использовать SSD.

AST – это процесс перманентного перемещения данных между разными по стоимости устройствами в соответствии с «температурой» данных: чем данные горячее, тем дороже и соответственно быстрее может быть устройство, то есть SSD, а холодные данные можно переместить на ленту. Для этого AST по заданным алгоритмам периодически просматривает данные и осуществляет перемещение, руководствуясь температурой.

Следует различать функции AST с той ролью, которую играет кэш-память на флэш, подключаемая по NVMe. Принцип работы кэша проще, чем AST, любой кэш является инструментом, в него на время копируется фрагмент из более медленной памяти. Кэш – простой ускоритель, AST – оптимизирует использование ресурсов СХД.

Следует различать функции AST с той ролью, которую играет кэш-память на флэш, подключаемая по NVMe. Принцип работы кэша проще, чем AST, любой кэш является инструментом, в него на время копируется фрагмент из более медленной памяти. Кэш – простой ускоритель, AST – оптимизирует использование ресурсов СХД.

Работа с корпоративными данными является одной из важнейших составляющих цифровых изменений в компаниях. Эта работа требует наличия эффективных средств, поддерживающих интерфейс между иерархически организованными многоуровневыми системами хранения, аналитическими и другими технологиями, непосредственно служащими целям бизнеса. Такой интерфейс дает возможность трансформировать пассивно хранящиеся данные в важнейший актив предприятия, позволяющий извлекать полезные для принятия решений знания из накопленных данных. С возрастанием объема данных и появлением больших данных, значение взаимосвязи между данными и бизнесом многократно возрастает.

Отвечая на запросы, возникающие со стороны современного бизнеса, компания КРОК предложила собственную концепцию «Умное хранение данных», в соответствии с которой их хранение организуется с учетом их дальнейшего использования и возможности извлечения из них максимума полезной информации. Внедрение «Умного хранения данных» позволяет получить бизнес-преимущества за счет более эффективного использования корпоративной информации. Технологии, заложенные в концепцию «Умное хранение данных», распространяется как на структурированные данные, хранящиеся в реляционных СУБД, так и на стремительно возрастающие объемы неструктурированных данных. Совместно с партнером Dell EMС КРОК предоставляет возможность создавать производительную инфраструктуру для хранения данных на базе линейки массивов Dell EMC Unity. Благодаря гибкости и простоте управления можно легко объединять облачные среды, возможности all flash и гибридных СХД для перехода на новый уровень цифровой трансформации.

«Умное хранение данных» повышает экономическую эффективность работы с информацией за счет ее распределения по хранилищам, исходя из востребованности при одновременном соблюдении доступности данных для аналитических систем. К тому же поддержка рабочих процессов средствами «Умного хранения данных» позволяет повысить их надежность, поскольку данные хранятся и обрабатываются в общей и защищенной от сбоев среде. Перейти к новому подходу к хранению данных с помощью технологий Dell EMC можно максимально быстро и без капитальных затрат, воспользовавшись моделью Hardware as a Service.

Глазами очевидцев

Алексей Клепиков

вице-президент по ИТ,«Ингосстрах»

Владимир Колганов

руководитель направления «Системы хранения данных», «КРОК»Виктор Ремень

директор по ИТ,«Аэроэкспресс»

Павел Карнаух

руководитель подразделения системных инженеровDell EMC в России, Казахстане и Центральной Азии

Глазами очевидцев

Владимир Колганов

руководитель направления «Системы хранения данных», «КРОК»Виктор Ремень

директор по ИТ,«Аэроэкспресс»

Павел Карнаух

руководитель подразделения системных инженеровDell EMC в России, Казахстане и Центральной Азии

Алексей Клепиков

вице-президент по ИТ, «Ингосстрах»Глазами очевидцев

Виктор Ремень

директор по ИТ,«Аэроэкспресс»

Павел Карнаух

руководитель подразделения системных инженеровDell EMC в России, Казахстане и Центральной Азии

Алексей Клепиков

вице-президент по ИТ,«Ингосстрах»

Владимир Колганов

руководитель направления«Системы хранения данных», «КРОК»

Глазами очевидцев

Павел Карнаух

руководитель подразделения системных инженеровDell EMC в России, Казахстане и Центральной Азии

Алексей Клепиков

вице-президент по ИТ,«Ингосстрах»

Владимир Колганов

руководитель направления «Системы хранения данных», «КРОК»Виктор Ремень

директор по ИТ, «Аэроэкспресс»